前言

今天给大家介绍的是Python爬取小说数据并保存txt文档,在这里给需要的小伙伴们代码,并且给出一点小心得。

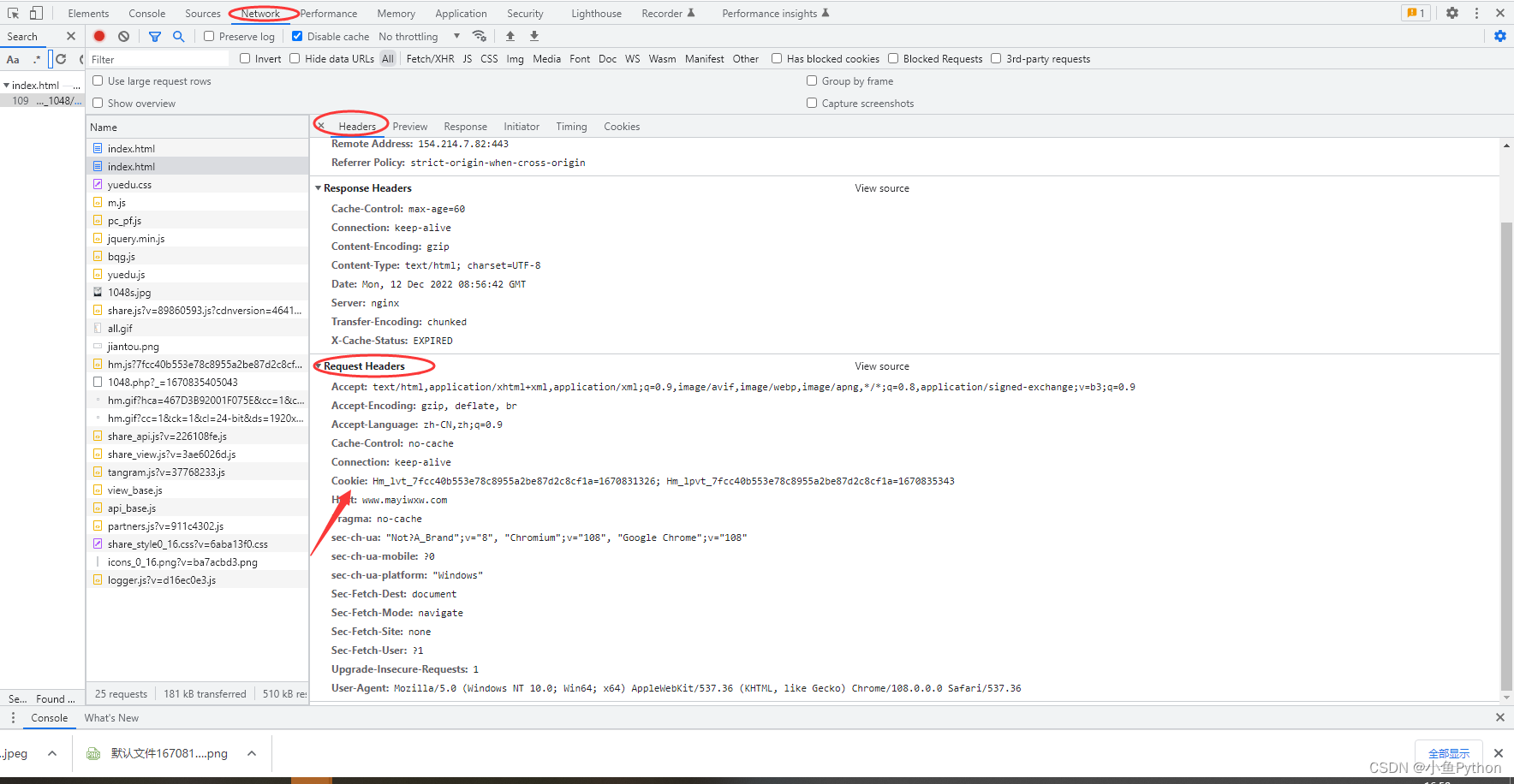

首先是爬取之前应该尽可能伪装成浏览器而不被识别出来是爬虫,基本的是加请求头,但是这样的纯文本数据爬取的人会很多,所以我们需要考虑更换代理IP和随机更换请求头的方式来对小说数据进行爬取。

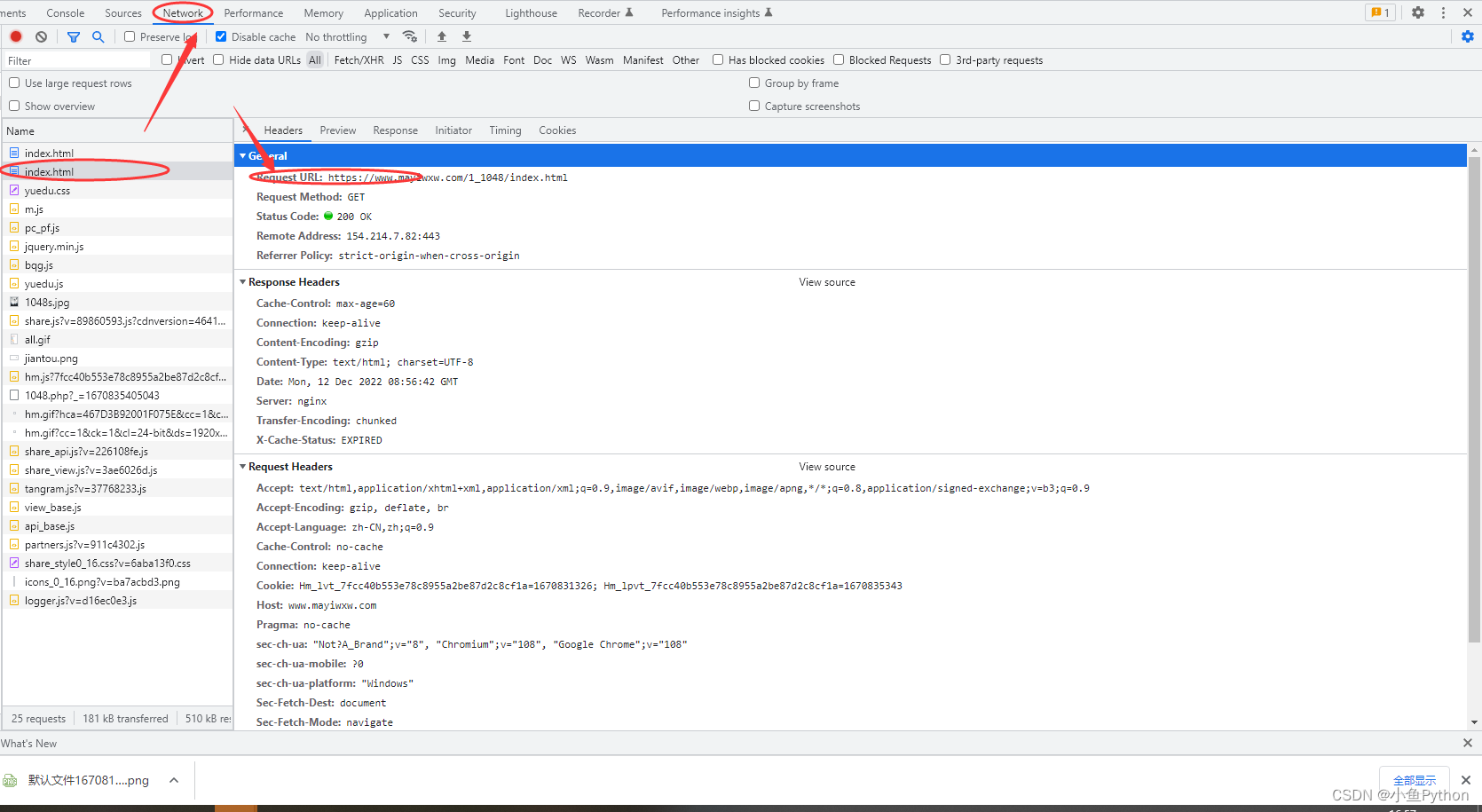

在每次进行爬虫代码的编写之前,我们的第一步也是最重要的一步就是分析我们的网页。

通过分析我们发现在爬取过程中速度比较慢,所以我们还可以通过禁用谷歌浏览器图片、JavaScript等方式提升爬虫爬取速度。

开发工具

Python版本: 3.6

相关模块:

requests模块

parsel模块

tqdm模块

pandas模块

环境搭建

安装Python并添加到环境变量,pip安装需要的相关模块即可。

文中完整代码及小说,评论留言获取

思路分析

浏览器中打开我们要爬取的页面

按F12进入开发者工具,查看我们想要的小说数据在哪里

这里我们需要页面数据就可以了

Cookie获取

代码实现

headers = {

\'User-Agent\': \'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/108.0.0.0 Safari/537.36\',

#\'Cookie\': \'你的Cookie\'

}

def get_response(html_url):

\"\"\"发送请求\"\"\"

# headers 字典类型 键值对 :隔开

# headers 请求头的作用: 把python代码伪装成浏览器对服务器发送请求

response = requests.get(url=html_url, headers=headers)

time.sleep(6)

return response

def save(name, title, content):

with open(name + \'.txt\', mode=\'a\', encoding=\'utf-8\') as f:

f.write(title)

f.write(\'\\n\')

f.write(content)

f.write(\'\\n\')

def get_novel_content(html_url):

response = get_response(html_url)

# parsel 解析数据 是需要把获取到的html字符串数据 转换成 selector 对象

# selector 对象 调用封装好的 css选择器 xpath

# 解析数据 提取小说url章节地址 小说名字

selector = parsel.Selector(response.text)

# css选择器 通过标签属性 提起数据

name = selector.css(\'#info h1::text\').get()

href = selector.css(\'#list dd a::attr(href)\').getall()

# get 获取一个标签内容[字符串] getall 是获取所有标签属性内容[列表]

# 想要把列表里面每一个元素都提取出来的话, 是需要通过遍历

for index in href:

# https://www.biquges.com/10_10770/6896120.html

index_url = \'https://www.biquges.com\' + index

response_1 = get_response(index_url)

selector_1 = parsel.Selector(response_1.text)

title = selector_1.css(\'.bookname h1::text\').get()

print(title)

content_list = selector_1.css(\'#content::text\').getall()

# 保存文本数据 是字符串的形式

# 把列表转换成字符串 str() 强制转换数据类型

content = \'\'.join(content_list)

save(name, title, content)

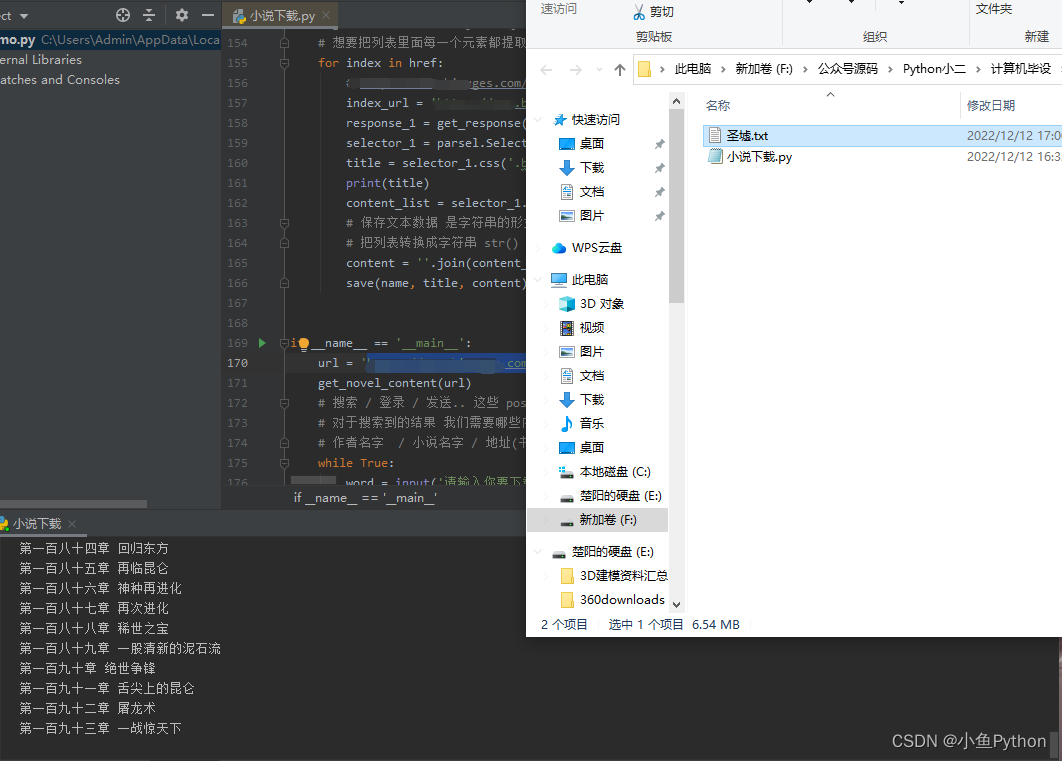

结果展示

最后

今天的分享到这里就结束了 ,感兴趣的朋友也可以去试试哈

对文章有问题的,或者有其他关于python的问题,可以在评论区留言或者私信我哦

觉得我分享的文章不错的话,可以关注一下我,或者给文章点赞(/≧▽≦)/

来源:https://www.cnblogs.com/guzichuan/p/17009439.html

本站部分图文来源于网络,如有侵权请联系删除。

百木园

百木园